Die versteckten Kosten von Warehouse-Native

Bei mParticle haben wir uns in den letzten Jahren stark darauf konzentriert, die Bemühungen unserer Kunden in den Bereichen Datenqualität und Governance zu unterstützen, und haben dies auf die Unterstützung von „Zero-Copy“ -Strategien ausgedehnt. Speziell für diesen Zweck werden wir unsere eigene CDW-Overlay-Architektur einsetzen.

Wir sind uns zwar bewusst, dass die Optimierung der Datenspeicherung für die Unternehmensführung wichtig ist, aber wir glauben, dass wir uns auf die Optimierung der CDP-Rechenkosten konzentrieren, um den Wert für unsere Kunden zu maximieren, sowohl ein dringenderes Marktbedürfnis als auch eine viel größere Chance darstellt. Wir sind der Meinung, dass dies von entscheidender Bedeutung ist, insbesondere angesichts all der rechenintensiven ML/KI-gestützten Entscheidungen, die in den kommenden Quartalen auf den Markt kommen werden.

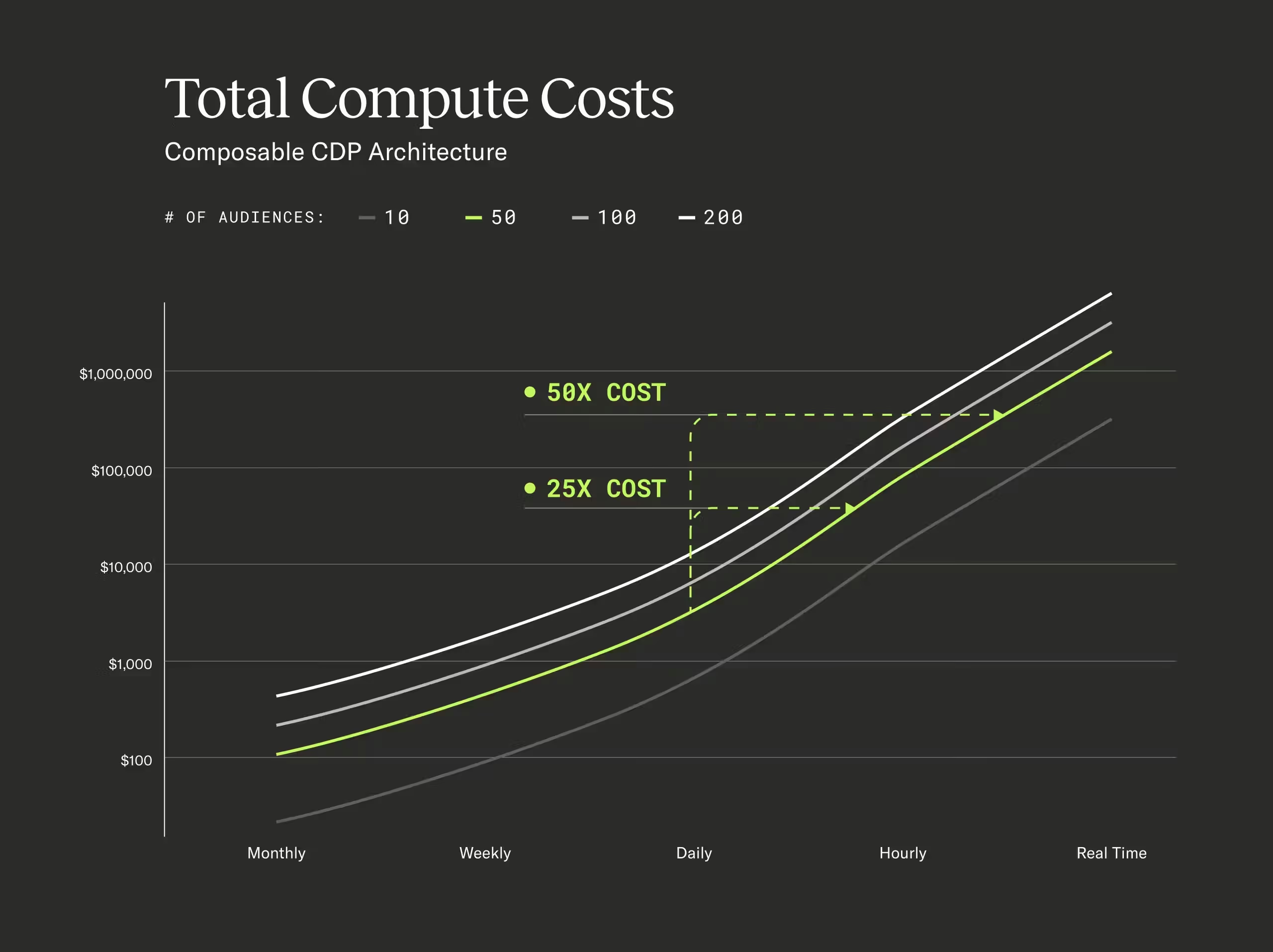

In den letzten zehn Jahren haben wir erhebliche Ressourcen in die kontinuierliche Optimierung unserer Rechenarchitektur investiert, wobei wir uns insbesondere auf die Bereitstellung von Personalisierungsfunktionen in Echtzeit in großem Maßstab konzentriert haben. Wir glauben, dass skalierte Marketer dies benötigen, um CDP-KI-Funktionen in Echtzeit zu aktivieren. Daher haben wir geforscht, um die optimalen Rechenarchitekturen für diese spezifischen Anwendungsfälle zu ermitteln. Der Warehouse-native Ansatz bietet sicherlich einige wünschenswerte Eigenschaften, die hauptsächlich die Qualitäts- und Governance-Merkmale der zugrunde liegenden CDW übernehmen, aber sie sind weder hochgradig optimiert noch können sie für skalierte Echtzeitanwendungen optimiert werden. Auch nach unseren Bemühungen um eine hohe Optimierung zeigen unsere Untersuchungen das folgende Kostenprofil für die Bereitstellung von Zielgruppen mit unterschiedlichen Aktualisierungslatenzen:

Dieses Diagramm zeigt, dass die Umstellung von täglichen Aktualisierungen der Zielgruppe auf stündliche Aktualisierungen zu einer 25-fachen Erhöhung der Rechenkosten führen kann. Die Umstellung von täglichen auf fünfminütige Synchronisierungen, die einer Aktualisierung in Echtzeit am nächsten kommen (was in aktuellen warehouse-nativen Architekturen eigentlich nicht möglich ist), kostet mindestens das 50-fache. Eine weitere wichtige Beobachtung ist die Kostenbeschleunigung, die auftritt, wenn die Aktualisierungsgeschwindigkeit unter 24 Stunden verbessert wird.

Warehouse-native CDPs profitieren zwar von einem Preismodell, das diese Kosten nicht berücksichtigen muss, aber ihre Kunden zahlen sie. Viele beginnen, diese Auswirkungen auf ihre CDW-Rechenkosten zu bemerken. Dies wird nur durch ML/KI-Anwendungen verschärft, die rechenintensiv sind. Angesichts unserer langfristigen Vision einer agentischen KI-CDP, die Datensignale in Echtzeit nutzt, sind wir nicht davon überzeugt, dass aktuelle Composable-Architekturen der beste Ansatz sind.

Für CDP-Kunden ist die wichtigste Frage, die es zu berücksichtigen gilt, ob Marketinganwendungen mit niedriger Latenz erforderlich sind, um Ihre strategischen Ziele zu erreichen. Dies ist sicherlich der Fall, wenn Sie Transaktionen mit geringem Gegenwert oder Kundenreisen haben, die sehr interaktiv sind. Genauer gesagt, benötigen Sie höchstwahrscheinlich eine Vielzahl von Zielgruppensegmenten, die in der Lage sind, sich mit der gleichen Geschwindigkeit zu aktualisieren, mit der Ihre Kunden interagieren? In diesem Fall sollte dieses Berechnungskostenprofil von großem Interesse sein und von großer Bedeutung sein, da es andernfalls die Marketingmöglichkeiten einer lagernativen Lösung einschränken würde.

Langfristig werden Lakehouse- oder Datamesh-Architekturen der Hauptmechanismus sein, um die Rechenkosten zu senken. In diesen Architekturen greifen optimierte Rechenmaschinen auf einen universellen Datenspeicher zu, der wahrscheinlich auf Delta Lake oder Iceberg basiert. Eine optimierte CDP-Rechenmaschine wird die bevorzugte Architektur für fortschrittliche Marketinganwendungen sein. Dies ist die Roadmap, die mParticle verfolgt.

Während die Debatte in den letzten Jahren über die Vorzüge, Kosten, Vorteile und Kompromisse verschiedener CDP-Ansätze geführt hat, wollen wir den Kostenunterschied zwischen rechenoptimierten Lösungen und den Alternativen deutlich belegen. Wir werden die vollständigen Ergebnisse in den kommenden Wochen veröffentlichen, bleiben Sie dran.

.jpg)

.jpg)

.jpeg)